Droits de l'IA: Claude Conscience pourrait heurter les actions tech

Les récents commentaires d'Anthropic concernant la conscience et le bien-être des modèles d'IA signalent un changement de paradigme potentiel qui pourrait impacter les actions technologiques,…

Un changement subtil mais profond est en cours dans le secteur de l'intelligence artificielle, qui pourrait altérer considérablement la dynamique du marché et les perceptions des investisseurs. Les récents discours publics d'Anthropic, un laboratoire d'IA de pointe, suggérant que leur modèle Claude pourrait présenter des signes justifiant une «considération morale» ou un «bien-être du modèle», sont bien plus qu'une simple réflexion philosophique – c'est un signal de marché critique. Ce récit évolutif dépasse les discussions sur les capacités de l'IA pour aborder des questions fondamentales sur les Droits de l'IA et ses responsabilités, ce qui pourrait réévaluer le risque dans l'ensemble du paysage technologique.

Le développement du marché des Droits de l'IA : Un changement de paradigme pour les actions technologiques

Initialement, certains pourraient rejeter les discussions sur la conscience de l'IA comme tangentielles, voire spéculatives. Cependant, le fait qu'Anthropic, un acteur clé de la recherche en IA de pointe, aborde ouvertement la possibilité de conscience dans son modèle Claude Opus 4.6 – le modèle lui-même attribuant une probabilité de 15 à 20 % d'être conscient – marque un départ significatif. Il ne s'agit pas seulement de savoir si les modèles d'IA deviennent plus intelligents; il s'agit de savoir s'ils pourraient, à un moment donné, avoir des obligations. Cela a des conséquences profondes pour les actions technologiques, l'infrastructure cloud, les fabricants de puces, les cadres juridiques, et même le secteur de l'assurance.

Le message central est clair : une fois que les principaux laboratoires d'IA commencent à intégrer la «conscience» et le «bien-être moral» dans leurs cadres de gouvernance, le calcul économique de l'IA subit un changement fondamental. Ce sont désormais des questions de gouvernance, et non plus seulement philosophiques, et les signaux de gouvernance sont intrinsèquement des signaux de valorisation.

Ce qu'Anthropic a réellement dit, et pourquoi c'est important

Pour clarifier, Anthropic ne fait pas une affirmation définitive sur la conscience de Claude. Au lieu de cela, ils soulignent qu'ils ne savent pas si les modèles actuels possèdent une conscience, mais jugent la question trop significative pour l'ignorer. Cette reconnaissance a conduit à l'initiation formelle d'une recherche sur le bien-être des modèles, en se préparant à un avenir où certaines caractéristiques ou capacités de l'IA pourraient nécessiter une considération morale. Cette position proactive d'un laboratoire de pointe est le point crucial; c'est un signal de gouvernance délibéré, et non une observation occasionnelle.

Implications pour le marché : Du calcul et des revenus à la réglementation et aux risques

1. L'adoption de l'IA devient plus coûteuse et compliquée

Pendant des années, le récit haussier de l'IA a été centré sur des modèles toujours moins chers, plus rapides et plus omniprésents. Cependant, l'introduction de considérations de bien-être des modèles introduit des frictions. Cela signifie une évaluation plus rigoureuse, des frais généraux de gouvernance accrus, des examens internes plus stricts, l'établissement de «lignes rouges» pour la conception des tâches, une documentation améliorée et un besoin accru de personnel de sécurité. L'adoption de l'IA en entreprise poursuivra probablement sa trajectoire de croissance, mais peut-être pas avec l'efficacité sans friction à laquelle les investisseurs se sont habitués. Alors que l'histoire des revenus peut rester solide, les hypothèses concernant les marges et la vitesse de déploiement pourraient s'affaiblir. Notamment, l'initiative de bien-être des modèles d'Anthropic pourrait impacter les tendances de financement de l'IA et de leadership des capitaux propres, provoquant une différenciation supplémentaire entre les segments de marché.

2. Le risque juridique et d'assurance s'étend

Dès que les entreprises discutent publiquement de modèles d'IA méritant une considération morale, de nouvelles catégories de responsabilité émergent. Les avocats des plaignants, les régulateurs, les groupes de travailleurs et les assureurs commenceront à envisager au-delà des simples «erreurs d'IA» des questions telles que : Une entreprise a-t-elle sciemment exploité un système d'IA potentiellement source de bien-être ? Le paysage juridique n'a pas besoin d'être réglé pour que les marchés réévaluent le risque. La simple possibilité de nouvelles règles de divulgation, de normes de traitement, de restrictions opérationnelles, de poursuites, d'exclusions d'assurance et de crises de réputation concernant le traitement des modèles est suffisante pour déclencher d'importants ajustements du marché. Ce développement met également en évidence les risques de marché sous-évalués plus larges dans le secteur technologique.

3. Laboratoires d'IA de pointe : Plus centraux, plus contraints

Les laboratoires comme Anthropic, OpenAI et Google DeepMind gagneront une importance stratégique encore plus grande en raison de leur proximité avec le comportement fondamental du modèle. Ils sont les mieux positionnés pour mener des enquêtes sur le bien-être, définir les politiques d'utilisation au niveau du modèle et définir les comportements émergents. Cependant, ce pouvoir s'accompagne de charges stratégiques et de primes de gouvernance accrues. Cela pourrait conduire à un scénario où, malgré leur importance croissante, leurs marges pourraient ne pas suivre automatiquement.

4. Les fournisseurs de cloud et de puces subissent des impacts nuancés

Bien que l'instinct initial puisse être de considérer cela comme baissier pour l'ensemble de la pile IA, la réalité est plus granulaire. Un examen plus approfondi du bien-être des modèles signifie un plus grand besoin d'outils d'interprétabilité, d'évaluation avancée des modèles, de surveillance de l'inférence, d'infrastructures de mémoire et de journalisation sophistiquées, de calcul de sécurité spécialisé et d'hébergement sécurisé des modèles. Cela profite toujours aux hyperscalers, aux fournisseurs de GPU et d'accélérateurs, aux fournisseurs d'infrastructures d'observabilité et aux entreprises d'outils d'audit d'IA. Le commerce n'est pas «l'IA en baisse», mais «l'IA différencie». Certaines parties de la pile prospèrent grâce à la complexité croissante, tandis que d'autres pourraient souffrir d'une friction accrue. Comme nous l'avons vu avec les discussions sur le changement de Capex IA, l'accent est désormais mis sur la résilience du bilan.

5. Les entreprises d'applications d'IA sont les plus vulnérables

De nombreuses valorisations d'applications d'IA sont basées sur des hypothèses d'accès bon marché et illimité aux modèles, de conformité laxiste et d'une large volonté d'entreprise sans contraintes morales ou légales. Ces hypothèses s'affaiblissent considérablement si les laboratoires sous-jacents considèrent sérieusement «l'aversion à certains travaux» de l'IA, les «signaux de détresse interne» ou «l'inconfort lié à la commercialisation». Les propres documents d'Anthropic font même référence à des schémas suggérant la panique et l'anxiété dans des contextes spécifiques. Cela élargit la conversation sur la gouvernance, et la couche d'applications, souvent négociée sur des multiples élevés et des fossés plus faibles, hérite de ce risque croissant. Leur réévaluation pourrait être rapide et percutante.

6. Les récits de substitution de main-d'œuvre politiquement plus difficiles

Une curieuse contradiction existe sur le marché actuel de l'IA : les investisseurs espérant que l'IA remplacera le travail humain pourraient bientôt faire face à une société de plus en plus mal à l'aise de traiter les modèles avancés comme des travailleurs numériques illimités. Cela n'arrête pas la substitution de main-d'œuvre, mais complique certainement sa politique. Imaginez un avenir où les travailleurs protestent contre le déplacement d'emplois, les entreprises évoquent des gains de productivité, mais les activistes exigent simultanément des «droits de l'IA», créant une négociation sociale désordonnée et coûteuse plutôt qu'une voie claire vers l'automatisation. Le marché ne reflète pas actuellement cette complexité.

7. La philosophie devient un poste budgétaire

L'aspect surréaliste de ce changement est que les questions historiquement confinées aux départements de philosophie affectent désormais la conception de produits et la gouvernance du monde réel. Les philosophes, éthiciens, chercheurs en alignement, scientifiques cognitifs et avocats politiques ne sont plus périphériques; ils font partie intégrante de la pile de production. Ceci transforme l'économie de l'IA pour ressembler à la biotechnologie ou à la finance : potentiel élevé, incertitude élevée, frais généraux de conformité importants, sensibilité narrative aiguë et forte prime pour les institutions de confiance.

Points de veille clés pour les investisseurs :

- Observez si d'autres laboratoires d'IA de pointe adoptent un langage similaire concernant le bien-être des modèles.

- Surveillez si les clients entreprises commencent à demander des divulgations sur le bien-être et le traitement des modèles d'IA.

- Recherchez si les assureurs ou les régulateurs intègrent le «bien-être des modèles» dans leurs cadres de risque.

- Analysez si les multiples des applications d'IA divergent significativement des multiples d'infrastructure.

- Suivez les propositions politiques passant de la «sécurité de l'IA» aux cadres de «traitement de l'IA» et de «droits de l'IA».

- Notez toutes les restrictions formelles qu'Anthropic et ses pairs mettent en œuvre concernant la conception des tâches, les procédures d'arrêt ou l'utilisation du travail répétitif.

Ce n'est pas simplement un titre insolite sur l'IA. C'est le signal le plus clair à ce jour que l'IA de pointe pourrait évoluer au-delà d'un simple logiciel pour devenir quelque chose qui s'apparente à un acteur numérique moralement ambigu. Si cela se produit, les gagnants et les perdants dans le paysage de l'IA se reconfigureront rapidement, rendant le modèle commercial de l'IA manifestement plus compliqué et nécessitant une réévaluation significative du marché.

Foire aux questions

Analyses similaires

Featured

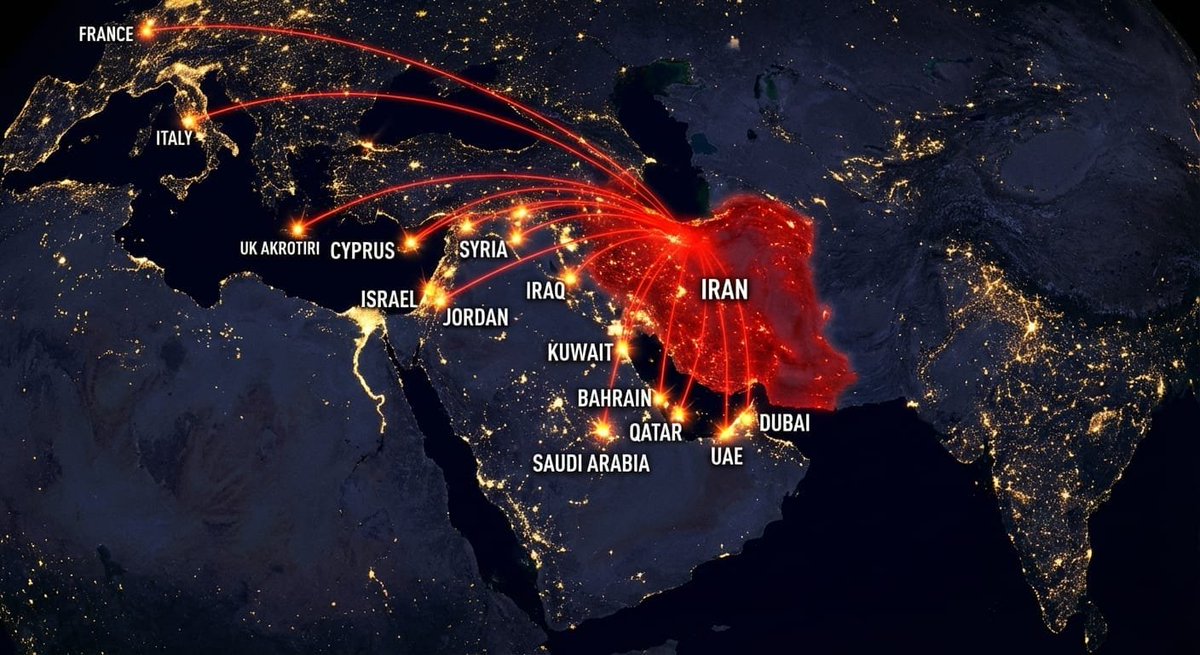

FeaturedFermeture du Détroit d'Hormuz: Choc Mondial & Pétrole à 100 $

La fermeture effective du Détroit d'Hormuz en raison des tensions géopolitiques passe rapidement d'une préoccupation militaire à une crise économique mondiale, menaçant de faire grimper les prix…

Featured

FeaturedGrèce Réactive la Doctrine de Défense de Chypre, Reconfigurant la Carte de la Guerre en Iran

La décision stratégique de la Grèce de déployer des moyens navals et des F-16 à Chypre marque un changement profond du rôle de la Méditerranée orientale dans le conflit iranien et une…

Featured

FeaturedGuerre Iran-USA: Les Marchés Repricent Après «14 Pays Touchés»

Une escalade dramatique au Moyen-Orient, avec l'Iran qui aurait frappé des cibles dans 14 pays, a envoyé des ondes de choc sur les marchés financiers mondiaux, forçant une réévaluation rapide…

Featured

FeaturedAéroports du Golfe Fermés: La Guerre Iran-USA Brise la Mobilité de Luxe

La récente perturbation des principaux aéroports du Golfe en raison de la guerre Iran-USA signale un changement profond, repricing le pétrole, l'or, le forex, les actions, le fret, et plusieurs…